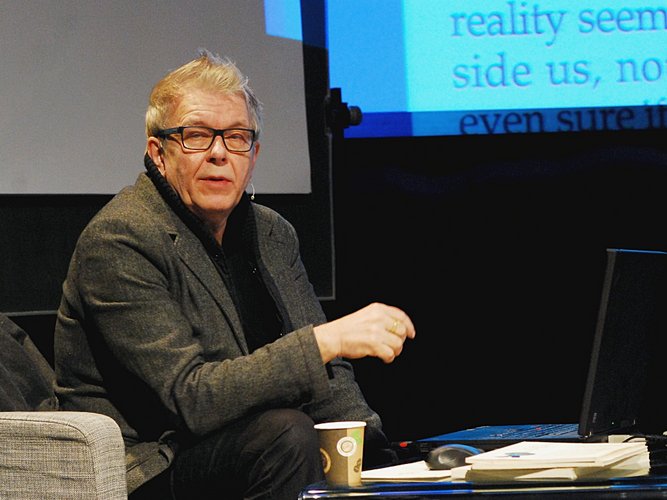

Filmowiec eksperymentator, artysta wizjoner,

jedyny polski laureat Oscara za film, opowiada o swoim wielkim

marzeniu: idei rzeczywistości wirtualnej, tworzeniu ruchomego obrazu,

składającego się z dowolnych elementów.

Zbigniew Rybczyński – filmowiec eksperymentator, artysta wizjoner,

jedyny polski laureat Oscara za film – opowiada o swoim wielkim

marzeniu: idei rzeczywistości wirtualnej, tworzeniu ruchomego

obrazu, składającego się z dowolnych elementów. Nad realizacją tego

marzenia pracuje od czasów studiów w Szkole Filmowej w Łodzi.

Zbudował w Nowym Jorku swoje „studio Idealne”. Rok temu rozpoczęło

działalność stworzone przez niego we Wrocławiu Centrum Technologii

Audiowizualnych. Podobno nie ma drugiego takiego na świecie. Jednak

Rybczyński czuje się artystą nierozumianym. – Nikt nie chce mnie

słuchać – narzeka. Może dlatego, że jego „badania” pochłaniają

miliony dolarów, a efekty na razie niepewne i mało spektakularne.

Może dlatego, że bezkompromisowy artysta nigdy nie znajdzie

wspólnego języka z urzędnikami i politykami, którzy dzielą

publiczne pieniądze. Skutek jest taki, że został przez nich

oskarżony o nadużycia finansowe, a rozwój jego wrocławskiego studia

stanął pod znakiem zapytania. Mimo tych przeciwności z pasją

opowiadał o swojej wizji studentom Szkoły Filmowej w Łodzi.Zbigniew Rybczyński:

Jesteśmy u progu nowej epoki tzw. rzeczywistości wirtualnej. Mówi się o tym od wielu lat, ale naprawdę nie mamy jeszcze takiej technologii. Podstawową sprawą będzie obraz. Konstruowanie obrazu wciąż jest bardzo trudną sprawą. To skandal, że nakręcenie dwugodzinnego filmu takiego jak „Avatar” kosztuje drożej niż zbudowanie wieżowca. Coś tu się nie zgadza. Od wielu lat pracuję nad tym, by można było konstruować obraz z warstw. To jest to samo, co od dawna robi się z dźwiękiem, czyli nagrywanie wielościeżkowe. Utwór, jaki słyszymy na płycie, najczęściej składa się z połączonych równolegle wielu śladów (poszczególne instrumenty, śpiew, efekty dźwiękowe), warstw dźwiękowych, które razem tworzą całość. Można, słysząc nagranie, jednocześnie nagrywać kolejną warstwę. Natura dźwięku jest prosta – wystarczy synchronicznie odtwarzać poszczególne warstwy. Z obrazem jest dużo trudniej.

W szkole filmowej z kolegami z Warsztatu Formy Filmowej

robiliśmy eksperymentalne filmy i to zaważyło na moim życiu

artystycznym. Chcieliśmy robić coś innego, dla siebie. „Kwadrat” –

to mój pierwszy film. Sfotografowałem z góry ludzką postać, która

wykonuje różne ruchy na czarnym aksamicie, by na końcu powrócić do

pozycji początkowej. Powstała pętla ruchu. Umieściłem tę postać na

tle kwadratu. Potem zacząłem dzielić go na coraz mniejsze równe

pola. Kwadrat będący w obrębie postaci podświetlał się. Kiedy

podział był już daleko posunięty, postać składała się z maleńkich,

podświetlonych kwadracików. Nie byłem świadomy, bo żyliśmy w

odciętym od świata kraju, że gdzieś w Stanach Zjednoczonych

naukowcy pracują w tym czasie nad czymś, co zrewolucjonizuje nasz

świat. Nad rozwojem programów komputerowych oraz innym nośnikiem

obrazu – elektronicznym obrazem złożonym z maleńkich kwadracików,

czyli pikseli. Dziś myślę, że mój „Kwadrat” był taką równoległą

koncepcją digitalnego obrazu.

Kiedy Dennis Ritchie tworzył język komputerowy, w 1978 roku

byłem w Wiedniu i rysowałem swoje „Tango”. Ten film to gigantyczna

operacja matematyczna. Każdy kadr był podzielony na wiele cząstek i

fotografowany wiele razy. Musiałem kontrolować wiele parametrów.

Składałem obraz z wielu celuloidów nałożonych na siebie i tak

klatka po klatce. Tworzyłem maski i kontrmaski dla różnych grup i

postaci. Gigantyczna praca. Nauczyłem się sposobu myślenia

podobnego jak przy pisaniu programów komputerowych. Kiedy

przyjechałem do Ameryki w 1983 roku, w wywiadzie dla „Interview

Magazine” powiedziałem, co było zupełną fantazją, że pojawi się

nowa forma obrazu telewizyjnego, który będzie się składał nie z

linii a z pikseli, i że to będzie rewolucja. Wszyscy się wtedy ze

mnie śmiali, ale to ja miałem rację.

W Stanach – to był 1984, 1985 rok – zacząłem robić klipy muzyczne, bo wydawało mi się, że to jest ciekawe, że coś zaczyna się wyraźnie zmieniać w technikach wideo. Zobaczyłem studia telewizyjne i produkowane tam fantastyczne obrazy. Powstała wtedy stacja MTV, pojawiły się urządzenia komputerowe do realizacji obrazu. Były pieniądze na krótkie formy audiowizualne i możliwość natychmiastowej dystrybucji w telewizji. Zobaczyłem, że muzycy to ciekawi ludzie – walczą o coś, nie trzymają się schematów. A najważniejsze, że to wszystko przeznaczone jest dla młodej publiczności. Spodziewałem się, że to, co się dzieje, zmieni i muzykę, i film, czyli ruchomy obraz. Nadszedł czas, kiedy jedno narzędzie robi i muzykę, i film – to komputer. Zdałem sobie sprawę, że w technice wideo (inaczej niż w filmie na taśmie światłoczułej) można sterować obrazem, każdą jego klatką.

Zrobiłem eksperyment, który zmienił moje życie. Był trudny, bo

wtedy jeszcze pracowałem w technologii analogowej. To był teledysk

zespołu Simple Minds. Nagrywałem na zakładkę – na już nagraną

postać nakładałem kolejne nagranie tej samej postaci w dalszej

fazie ruchu, potem następny raz, kolejny i tak dalej. Umożliwiły mi

to dwie maszyny wideo współpracujące ze sobą tak, żeby nagrywany

obraz nie zmazywał poprzedniego. W „Tangu” musiałem wykonać

kilkanaście tysięcy rysunków na celuloidach i wszystkie je

odpowiednio spasować. Tutaj załatwiała mi to telewizja z nagraniem

żywych postaci zamiast tych wszystkich rysuneczków. Stwierdziłem,

że tak należy robić filmy. Nagrywać je w wielu warstwach. Droga

była dobra, ale jakość obrazu pozostawiała wiele do życzenia.

Chciałem też mieć swobodę ruchu w tym świecie. Próbowałem wyobrazić

sobie, w którą stronę pójdzie rozwój komputerów, bo tego, że

zrewolucjonizują świat, byłem pewien.

Pomyślałem, że trzeba całkowicie zmienić perspektywę patrzenia, zmienić swój aksjomat. Wzorem był tu dla mnie Kopernik. Nie filmować obracającego się przedmiotu tylko samemu obracać się wokół niego. W „Tangu” nie mogłem się ruszyć. To był statyczny obraz. A przecież to, co przeżywamy w rzeczywistości, nasz mentalny obraz, to jest ciągły ruch w przestrzeni. Każdy dzień jest jakąś wędrówką, której wcale nie kończymy w czasie snu. Ruch jest rzeczą podstawową w obrazie. Studiowałem różne formy ruchu, budowałem rozmaite konstrukcje, które umożliwiłyby mi powtórzenie idealnie tego samego ruchu dla realizacji kolejnej warstwy filmu. W 1986 roku poznałem technologię high definition, czyli obraz elektroniczny w jakości filmu na taśmie światłoczułej. Pierwszy test z wykorzystaniem high definition to był klip do „Imagine” Johna Lennona.

Zacząłem pracować z blue screen – to była dla mnie jedyna metoda połączenia warstw. Robiłem w Luwrze film, siedzę w sali romantyków francuskich i myślę: cholera, co ja mam tu nakręcić. Ustawiłem jazdę w kształcie elipsy na całą salę. Nakręciłem ujęcia na wszystkie strony. Przyjechałem do swojego studia w Nowym Jorku. Wymyśliłem scenę obrotową – z jej ruchem zsynchronizowałem ruch kamery na wprost. Rezultat był taki, jakbym okrążył z kamerą tę scenę. To było pierwsze ujęcie mojego filmu „Orkiestra”. Myślę sobie: wow! Mimo że patrzę kamerą w jednym kierunku na obrazie wykonałem jazdę 360 stopni. No tak, ale poza tymi prostymi ruchami żadnych innych nie mógłbym idealnie powtórzyć. Zacząłem się interesować urządzeniami typu motion control, które George Lucas wprowadził w swoim pierwszym filmie „Star Wars”. Kamery poruszają się dzięki silnikom, a tymi silnikami sterują programy komputerowe. Ich koszt idzie w miliony dolarów.

Do filmu „Kafka” w 1991 roku zbudowałem swoje pierwsze

urządzenie, które było uniwersalne. Dzięki niemu, mówiąc w

uproszczeniu, można świat fotografować w częściach. Kamera patrzy

na bardzo skomplikowany świat, w którym są tysiące obiektów

(płaszczyzny, przedmioty). Zmiana aksjomatu: żeby każdy przedmiot

tego świata był w jednym wybranym punkcie kadru, to gdzie powinna

być moja kamera? Zmiana położenia obserwatora (perspektywy

patrzenia) powoduje „zmianę” położenia przedmiotu w kadrze. Możemy

ten przedmiot multiplikować w dowolnych pozycjach. W moim

urządzeniu ruch jest wypadkową trzech składowych: travel –

przybliżanie się i oddalanie, rzeczy widziane na prawo albo na

lewo, to załatwia panoramowanie – pan, są też widziane z różnej

strony – tym się zajmuje rotacja – R. To nie jest powtórzenie tego

samego ruchu w kolejnej warstwie. Obraz się składa z bardzo wielu

różnych ruchów. Połączenie tych wszystkich warstw sprawia wrażenie

zmiany położenia przedmiotu. Kiedy podpisywałem swój pierwszy

patent, sam nie całkiem rozumiałem, jak to jest, że przedmioty

fotografowane z różnym ruchem są ze sobą połączone w kadrze.

Nigdy nie pisałem scenariuszy do swoich testów. Na planie

improwizowałem, decyzje, co robić, podejmowałem spontanicznie.

Myślę, że taka będzie przyszłość filmu. Po co mamy coś pisać na

kartce i realizować to dopiero po kilku latach. Będziemy dysponować

taką technologią, że usiądziemy w kilka osób – reżyser, operator,

scenarzysta, kompozytor – i wszyscy będą twórcami filmu.

Umówimy się, że na początek chcemy mieć kobietę na pustyni i za

chwilę zobaczymy to na ekranie monitora. Po co pisać scenariusz.

Chcemy muzykę i dźwięk – bach – mamy to. To jest tworzenie

scenariusza. Ale dalej – mówimy: ta kobieta fajnie wygląda, ale za

nią niech na tej pustyni jedzie czołg. Robimy to. Dlaczego nie

moglibyśmy konstruować obrazu z dowolnych elementów, takich jak

rysunki, malarstwo, miniatury, modele, rzeźby, obiekty, ludzie,

zdjęcia zarejestrowane na rzeczywistym planie no i oczywiście

grafika komputerowa. Technologia daje nam wielką swobodę twórczą.

Wymyśliłem „Studio Ideale”. Chodzi oczywiście o tworzenie obrazów,

których nie możemy nakręcić normalnie jak np. reportaż

telewizyjny.

Nauczyłem się programowania, bo bez tego nic się nie zrobi.

Ci, którzy nie potrafią programować, są współczesnymi analfabetami.

Trzeba programować i oczywiście kochać… swój zawód. Studio we

Wrocławiu dla mnie było szansą na prowadzenie badań w dziedzinie

grafiki komputerowej, motion control, optyki, transmisji, Internetu

i programów do tworzenia obrazu przez komputer. Nie ma drugiego

takiego miejsca na świecie. To jest ogromny potencjał. Przecież

Japończycy przejęli produkcję urządzeń do rejestrowania oraz edycji

obrazu i zarobili na tym fortunę. W Polsce nie ma efektów

specjalnych. Nie tworzy się obrazu od zera. To jest tylko retusz

zdjęć zarejestrowanych na planie rzeczywistym.

Wszystkie filmy, które dotąd w życiu zrobiłem, nazywam testami albo eksperymentami. Bo ja jeszcze swojego filmu nie zrealizowałem. Moim celem nadal jest nakręcenie własnego filmu i chociaż praca nad narzędziami, nad rozwiązywaniem rozmaitych problemów technologicznych zajęła mi kilkadziesiąt lat, nie widzę w tym nic złego. Dlaczego miałbym trzepać co roku film za filmem?…

* W Atlasie Sztuki (ul. Piotrkowska 116) do 2 lutego można

oglądać retrospektywną wystawę twórczości Zbigniewa

Rybczyńskiego.